Résumez cet article avec  Chat GPT

Chat GPT Mistral

Mistral Perplexity

Perplexity Grok

Grok

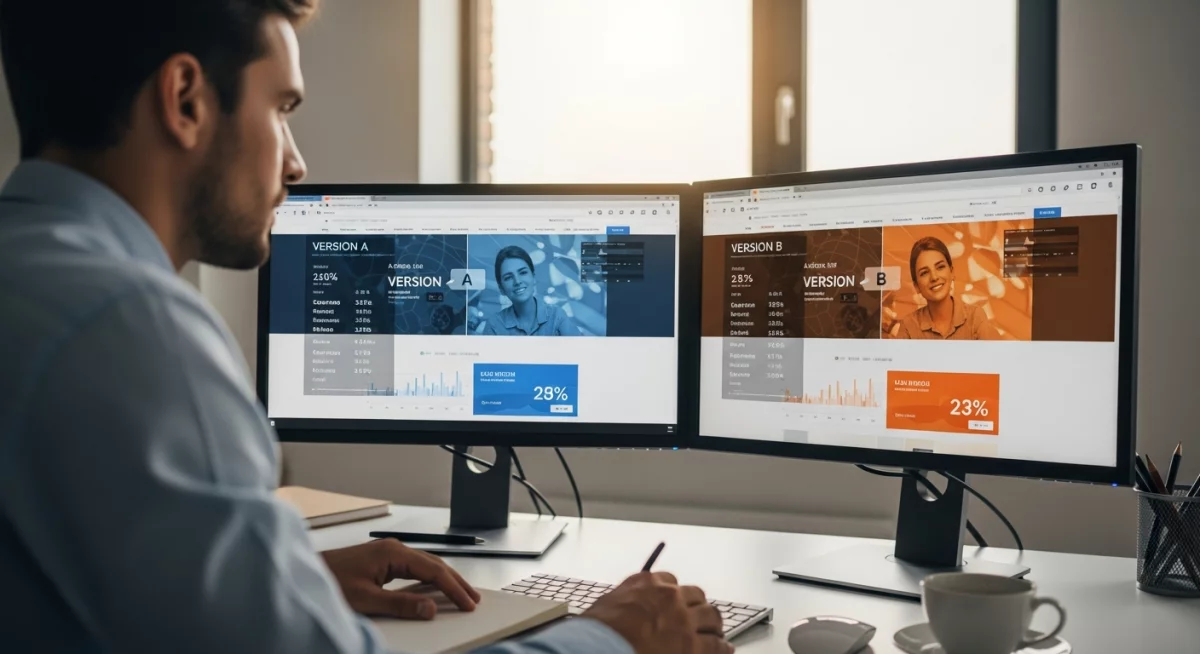

L'A/B testing représente l'une des méthodes les plus puissantes pour optimiser les conversions de votre site web ou application. Pourtant, nombreux sont les professionnels qui hésitent à se lancer, faute de connaître la méthode A/B testing adaptée. Ce guide détaille précisément comment faire un A/B test de manière méthodique, en évitant les erreurs courantes qui invalident les résultats.

À retenir :

- Un A/B test compare deux versions d'un élément pour identifier la plus performante

- La réussite repose sur une méthodologie rigoureuse : hypothèse, test, analyse

- Les outils adaptés et la signification statistique sont essentiels pour des conclusions fiables

- L'optimisation en continu via des tests réguliers améliore durablement vos performances

Qu'est-ce qu'un A/B test et quand l'utiliser ?

Un A/B test, également appelé test fractionné, consiste à comparer deux versions d'un même élément auprès de deux groupes d'utilisateurs distincts. La version A (contrôle) est opposée à la version B (variante) pour mesurer laquelle génère les meilleurs résultats sur vos indicateurs de performance.

Cette approche d'optimisation en continu s'avère particulièrement efficace pour tester différents éléments : un call-to-action optimisé, l'impact des couleurs sur clics, les titres, les images, ou encore les options de mise en page. Les tests A/B sur site web permettent de prendre des décisions basées sur des données réelles plutôt que sur des intuitions.

Avant de vous lancer, assurez-vous de disposer d'un trafic suffisant. Un volume minimum de 1000 visiteurs par mois est généralement recommandé pour obtenir des résultats statistiquement significatifs. L'échantillonnage aléatoire et une répartition du trafic équitable entre les versions sont des prérequis fondamentaux.

Les étapes de l'A/B testing : méthodologie complète

Pour comprendre comment faire un A/B test efficace, suivez ces étapes de l'A/B testing dans l'ordre. Première étape cruciale : définir l'objectif du test. Identifiez précisément ce que vous souhaitez améliorer, qu'il s'agisse du taux de conversion par page, du taux de rebond et optimisation, ou des taux de clics et conversions.

Ensuite, formulez une hypothèse claire basée sur vos observations. Par exemple : "Modifier la couleur du bouton d'inscription du bleu au orange augmentera le taux de clics de 15%". Cette hypothèse doit s'appuyer sur des données existantes, des analytics et A/B testing, ou le feedback des utilisateurs et tests précédents.

Identifiez ensuite les variables à tester. Concentrez-vous sur une seule variable indépendante à la fois pour isoler son impact réel. Tester simultanément plusieurs éléments relève du test multivarié, une approche plus complexe nécessitant un trafic beaucoup plus important.

| Étape | Action | Durée indicative |

|---|---|---|

| 1. Analyse | Identifier l'élément à optimiser via Google Analytics | 1-2 jours |

| 2. Hypothèse | Formuler une hypothèse testable et mesurable | 1 jour |

| 3. Création | Développer la variante B avec un seul changement | 2-5 jours |

| 4. Paramétrage | Configurer l'outil et la répartition 50/50 | 1 jour |

| 5. Lancement | Démarrer le test sans modification pendant sa durée | 1-4 semaines |

| 6. Analyse | Évaluer la signification statistique des résultats | 1-2 jours |

Sélectionner un outil de test adapté à vos besoins

Le choix de votre solution technique détermine en grande partie la réussite de votre démarche. Pour sélectionner un outil de test, plusieurs options s'offrent à vous selon votre niveau technique et votre budget. Google Optimize (gratuit) reste une référence pour débuter, même si le service évolue régulièrement.

Les outils de test A/B populaires incluent également Optimizely, VWO, AB Tasty ou Kameleoon pour des fonctionnalités avancées. Ces solutions offrent des interfaces visuelles permettant de modifier des éléments sans coder, ainsi que des tableaux de bord détaillés pour l'analyse des résultats A/B.

Pour les plateformes e-commerce, des outils natifs existent : Shopify propose des fonctionnalités d'A/B testing intégrées, tandis que WooCommerce s'appuie sur des extensions comme Nelio A/B Testing. Certaines solutions spécialisées intègrent également des heatmap et analyse de trafic pour enrichir votre compréhension du comportement utilisateur.

Comment analyser et interpréter les résultats d'un A/B test

L'interprétation des données constitue l'étape la plus délicate du processus. Un résultat n'est valide que s'il atteint la signification statistique, généralement fixée à 95% de confiance. Cette métrique indique que vous avez seulement 5% de risque que la différence observée soit due au hasard.

La durée minimale d'un test varie selon votre trafic, mais respectez toujours deux cycles complets (deux semaines minimum) pour neutraliser les variations liées aux jours de la semaine. Un test trop court ou arrêté prématurément figure parmi les erreurs communes en A/B testing. L'approche fréquentiste vs bayésienne influence également l'analyse : la première fixe une durée, la seconde permet une évaluation continue.

Au-delà du taux de conversion principal, examinez les métriques secondaires : temps passé sur la page, taux de rebond et optimisation, valeur moyenne des commandes. Parfois, une variante améliore un indicateur mais en dégrade un autre, nécessitant une analyse plus fine basée sur vos priorités business et votre retour sur investissement marketing.

Meilleures pratiques A/B testing et erreurs à éviter

Les meilleures pratiques A/B testing reposent d'abord sur la patience et la rigueur. Ne modifiez jamais un test en cours, même si les premiers résultats semblent décevants. Respectez la segmentation de l'audience initiale et évitez d'annoncer publiquement votre test, ce qui pourrait biaiser les comportements.

Adoptez un framework de priorisation des tests comme le modèle PIE (Potential, Importance, Ease) pour identifier les optimisations à fort impact. Concentrez vos efforts sur les pages à fort trafic et à fort enjeu business plutôt que sur des éléments secondaires. L'intégration de principes de conception UX et A/B testing améliore significativement vos résultats, notamment en réduisant la friction utilisateur et A/B testing.

Parmi les erreurs fréquentes : tester trop d'éléments simultanément, arrêter un test trop tôt, ignorer la saisonnalité, ou négliger la conception responsive et test sur mobile. Les exemples de tests A/B réussis montrent qu'une approche méthodique, documentée et répétée génère des améliorations cumulatives significatives. N'hésitez pas à combiner vos tests avec les leviers psychologiques de conversion pour maximiser leur efficacité.

Conclusion : intégrer l'A/B testing dans votre stratégie d'optimisation

Savoir comment faire un A/B test transforme radicalement votre approche de l'optimisation digitale. Cette méthode scientifique remplace les décisions subjectives par des choix éclairés, basés sur le comportement réel de vos utilisateurs. En suivant les étapes de l'A/B testing présentées et en évitant les erreurs courantes, vous maximiserez l'impact de chaque modification.

L'A/B testing n'est pas une action ponctuelle mais un processus continu d'amélioration. Chaque test, qu'il soit concluant ou non, enrichit votre connaissance de votre audience et affine votre stratégie d'optimisation en continu. Commencez dès aujourd'hui par identifier un élément à fort potentiel, formulez une hypothèse solide, et lancez votre premier test. Les gains cumulés sur plusieurs mois justifieront largement l'investissement initial en temps et en ressources.

Résumez cet article avec  Chat GPT

Chat GPT Mistral

Mistral Perplexity

Perplexity Grok

Grok